GPUサーバーとは?導入メリット、用途、選び方から最新機種まで【トゥモロー・ネット テックブログ】

近年、AI開発や3Dレンダリングなど、膨大なデータ処理を必要とする分野でGPUサーバーの導入が急速に進んでいます。

しかし、「GPUサーバーとは一体何なのか?」「導入することでどのようなメリットがあるのか?」といった疑問をお持ちの方も多いのではないでしょうか。

この記事では、GPUサーバーの基本から、導入メリット、主な用途、選び方、そして最新機種まで、GPUサーバーに関する様々な情報を網羅的に解説します。

GPUサーバーの導入を検討している方はもちろん、GPU技術に関心のある方も、ぜひ参考にしてください。

目次

そもそもGPUサーバーとは何か

GPUとは “Graphics Processing Unit” の頭文字を取ったもので、PCに搭載される半導体チップの1つです。GPUを日本語にすると「グラフィックス処理装置」という意味になり、名前の通り画像や映像の処理を行うことを目的として搭載されていますが、ある種の計算処理においては非常に優れた能力を発揮するハードウェアの一部です。

GPUサーバーとは、GPUを搭載し、高度な並列処理能力を持つサーバーのことです。先述の通り、PCには通常GPUが既に搭載されていますが、その処理できるキャパシティには限界があります。そのため、膨大な量の計算が必要とされるシーンにおいては、PCとGPUサーバーを繋げることで、より高い処理能力を実現させられます。

GPUサーバーを1台導入すれば、会社で使うPC全体の処理速度を劇的に向上させられます。そのため、データーセンター、製造、流通業界をはじめ、多くの業界で導入が進んでいます。

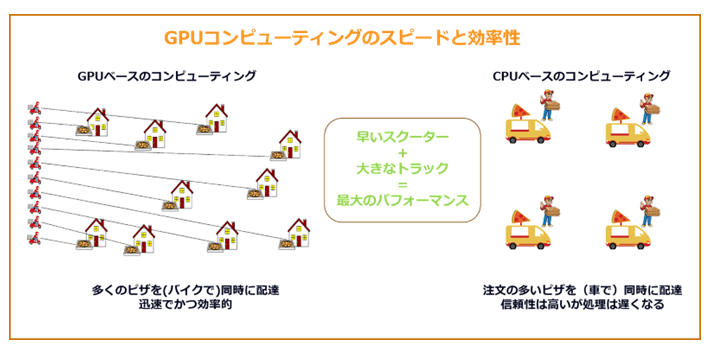

GPUとCPUの違い

CPU(Central Processing Unit)は、コンピュータ全体の制御や演算を行う中心的な役割を担います。

例えるなら、CPUはオーケストラの指揮者、GPUは多数の演奏者です。

CPUは複雑なタスクを順序立てて処理するのに長けていますが、GPUは単純なタスクを並列に処理する能力に優れています。

この並列処理能力こそが、GPUが画像処理やAIの学習など、大量のデータを高速に処理する必要がある分野で力を発揮する理由です。

GPUサーバーの種類

ひとくちにGPUサーバーといっても、大きく分けて「オンプレミス型」「クラウド型」があります。

ここでは、それぞれの特徴や違いについて、詳しく確認していきましょう。

種類①:オンプレミス型

自社でGPUサーバーを購入し、データセンターなどに設置する形態です。

メリット

- カスタマイズ性が高く、自社のニーズに合わせた最適な構成が可能

- セキュリティが高く、機密性の高いデータを扱う場合に安心

デメリット

- 初期費用が高額

- 運用・保守に専門知識が必要

種類②:クラウド型

クラウドプロバイダーが提供するGPUサーバーをインターネット経由で利用する形態です。

- 初期費用を抑え、必要な時に必要な分だけ利用可能

- 運用・保守が不要

デメリット

- カスタマイズ性が低い

- インターネット環境に依存する

- コストが読めない

GPUサーバー導入で得られる3つのメリット

GPUサーバーを利用すると、多くのメリットを得られます。

ここでは、代表的な3つのメリットについて、詳細を確認していきましょう。

メリット①:大規模なデータ処理の実現

GPUサーバーを利用すると、大規模なデータ処理が可能になります。

通常、PCで作業する際はCPUがデータ処理の中心を担い、GPUがそれをサポートします。しかし、データが大規模になると処理負荷が増大し、CPUと搭載されたGPUだけでは処理に限界が生じます。

ここでGPUサーバーを利用することで、内蔵GPUのリソースを気にせずに、常にスムーズなデータ処理が可能となります。

メリット②:処理速度の高速化

GPUサーバーを利用すると、PCでの処理速度を高速化させられます。

特にAI開発やディープラーニングなどの分野では、大量のデータを一度に扱うため、PC単体では処理にかかる時間が長くなりやすいです。しかし、GPUサーバーに繋いでいれば、大幅に処理時間を短縮させられるでしょう。

メリット③:CPUの負担軽減

GPUサーバーを利用することで、CPUの負担を軽減させられます。

一般的に、CPUは複雑な作業や連続的な処理を得意としますが、処理するデータ量が増えると限界が生じ、それらのタスクに遅延が生じます。その点、GPUサーバーを導入すれば、処理するデータ量が増えてもCPUに負担をかけず、常にスムーズな作業を実現させられるでしょう。

GPUサーバーの主な用途

GPUサーバーは、幅広い現場で活用されています。

ここでは、中でも代表的な3つの用途について、詳しく確認していきましょう。

用途①:AI / 機械学習

近年大きな話題を集めるAI開発や機械学習では、大量のデータを高速に処理することが求められます。その際、GPUサーバーを利用すれば、並列処理能力を大幅に向上させられます。そのため、さまざまなAI開発、機械学習のアルゴリズムに活用されています。

用途②:仮想デスクトップ

GPUサーバーは、仮想デスクトップで作業をする際にもよく使われます。仮想デスクトップは、複数の作業を並行して同時に行うために使われますが、その効率性や快適性はGPUの処理速度に大きく依存します。GPUサーバーを利用すれば、複数人でリモート作業したとしても、スムーズに作業を進められるでしょう。

用途③:研究開発

GPUサーバーは、研究開発の現場でも役立っています。たとえば、生命科学(ゲノム)の解析や、気象モデリングなどでは、複雑な計算が必要となりますが、GPUサーバーがあれば、正確な結果をスムーズに得られるでしょう。

用途④:3Dレンダリング

GPUサーバーは、映像やゲーム、建築デザインの制作などで使われる3Dレンダリングにも活用されています。GPUサーバーがあれば、高品質な画像や映像がスムーズに生成できるので、大規模なプロジェクトであっても、効率的に作業を進められるでしょう。

GPUサーバーの選び方:5つの重要ポイント

ここでは、GPUサーバーを選ぶ際に重視したいポイントを5点ご紹介します。

これからGPUサーバーの導入を検討している方は、ぜひ参考にしてください。

GPUの性能

GPUサーバーの性能は、搭載されているGPUの性能によって大きく左右されます。

GPUの性能を評価する上で重要な要素は、処理能力、メモリ容量、インターフェースの3つです。

処理能力は、GPUが1秒間にどれだけの計算処理を実行できるかを示す指標であり、数値が大きいほど高性能です。

メモリ容量は、GPUが一度に処理できるデータ量を表し、大規模なデータセットを扱う場合は大容量のメモリが必要です。インターフェースは、GPUとサーバー本体を接続する規格であり、最新の規格ほど高速なデータ転送が可能です。

サーバーの拡張性

GPUサーバーの拡張性は、将来的なニーズの変化に対応できるかどうかを判断する上で重要な要素です。

拡張性の高いサーバーは、メモリ、ストレージ、GPUなどを増設できるため、必要に応じて性能を向上させることができます。

特に、AI開発や機械学習などの分野では、データ量や計算処理の複雑さが日々増しているため、拡張性の高いサーバーを選ぶことが重要です。

冷却性能

GPUサーバーは、高負荷な計算処理を行うため、発熱量が大きいという特徴があります。

そのため、冷却性能の高いサーバーを選ぶことが重要です。

冷却性能が低いと、サーバーが熱暴走を起こし、故障や性能低下の原因となります。

冷却方式には、空冷、水冷などがあり、サーバーの設置環境や用途に合わせて適切な方式を選ぶ必要があります。

消費電力

GPUサーバーの消費電力は、運用コストに大きく影響します。

特に、24時間365日稼働させる場合は、消費電力の低いサーバーを選ぶことで、電気代を大幅に削減できます。

GPUの性能と消費電力はトレードオフの関係にあるため、性能と消費電力のバランスを考慮して選ぶことが重要です。

ソフトウェアの互換性

GPUサーバーを利用する上で、ソフトウェアの互換性は非常に重要な要素です。

使用するソフトウェアがGPUサーバーに対応しているかどうかを事前に確認する必要があります。

特に、AI開発や機械学習などの分野では、特定のGPUアーキテクチャに最適化されたソフトウェアが多いため、注意が必要です。

トゥモロー・ネットが提供するGPUサーバーに搭載されている主なGPU

ここでは、トゥモロー・ネットが取り扱われているGPUサーバーの一部について紹介します。

NVIDIA RTX 6000 Ada

NVIDIA RTX 6000 Adaは、最新のAda Lovelaceアーキテクチャを採用した高性能グラフィックスカードです。

48GBのGDDR6メモリを搭載しており、大規模なデータセットや複雑なシミュレーションにも対応可能です。また、18,176基のCUDAコアを備えており、高度な並列処理能力を提供します。

NVIDIA RTX 6000 Adaについては以下の記事でも詳しくご紹介しています。

NVIDIA RTX 6000 Ada 世代グラフィックス カードとは?製品の特徴を紹介

NVIDIA B200 GPU

NVIDIA B200は、データセンター向けの最新コンピューティングプラットフォームで、AIや機械学習のワークロードに最適化されたモデルです。

データセンターで必要とされる高い演算能力と効率性を提供し、膨大なデータ処理を高速に行える点が強みです。

NVIDIA B200については以下の記事でも詳しくご紹介しています。

NVIDIA B200とは?概要からスペックまで徹底解説

NVIDIA H200 Tensor Core GPU

NVIDIA H200 Tensor コア GPUは、HBM3eメモリを搭載した初のGPUで大容量かつ高速なメモリを提供し、科学コンピューティングによるHPCワークロードの推進と、生成AIや大規模言語モデル(LLM)の高速化を実現します。Llama 2のようなLLMを処理する際、従来のH100 GPUと比較して推論速度を最大2倍に向上させ、企業がより迅速に洞察を得られるよう支援します。

NVIDIA H200 Tensor Core GPU製品の詳細はこちら

NVIDIA H100 Tensor Core GPU

NVIDIA H100 Tensor Core GPUはあらゆるデータ センターにかつてない性能、拡張性、セキュリティを提供し、あらゆるワークロードに対応します。H100を搭載したサーバーは、GPUごとに毎秒3テラバイトのメモリ帯域幅を提供し、NVLinkとNVSwitchを使用することで高いスケーラビリティを実現します。これにより、膨大なデータセットに対する高性能なデータ分析が可能になります。

NVIDIA H100 Tensor Core GPU製品の詳細はこちら

NVIDIA L40 GPU

NVIDIA L40 GPUは、最新世代のRT、Tensor、およびCUDAコアのパワーを活用し、最も厳しいデータセンターワークロードに対して優れたビジュアライゼーションとコンピューティングパフォーマンスを提供します。電力効率に優れたハードウェアとコンポーネントを使用して設計されており、24時間365日のエンタープライズデータセンター運用に最適化されています。

NVIDIA L4 GPU

NVIDIA L4 GPUはビデオ、AI、グラフィックスを効率的に実現します。薄型フォームファクターで設計されたL4は、エッジ、データセンター、クラウドを含むすべてのサーバーにおいて、費用対効果が高く、エネルギー効率に優れたソリューションを実現し、高いスループットと低遅延を提供します。

まとめ

今回は、GPUサーバーについて、概要や導入するメリット、主な用途などについて詳しく確認してきました。GPUサーバーはPCの処理速度を大幅に拡張させられる設備です。そのため、AI開発や科学研究など幅広い分野で導入が進んでいます。

これからGPUサーバーの導入を行う方には、世界のAI技術をリードするNVIDIA社のGPU製品とSupermicro社のサーバーを組み合わせたGPUサーバーがおすすめです。NVIDIA社のパワフルなGPUシステムは、AI開発や科学研究、3Dレンダリングなどの用途でご活用いただいています。

トゥモロー・ネットでは、NVIDIA社、Supermicro社とのパートナーシップを結んでおり、GPUサーバーを1,000台以上導入してきた実績があります。

Supermicro社 と正規一次代理店トゥモロー・ネットのパートナーシップ

その他にも、AIインフラの選定・設計・構築・保守までを、ワンストップでサポートさせていただきます。GPUサーバーの導入をご検討の方は、ぜひお気軽にお問い合わせください。

Supermicro製 GPUサーバーの特徴や仕様についてはこちら

関連記事

クラウドコンピューティングとは?仕組みやメリット・デメリットを解説

この記事を書いた人

株式会社トゥモロー・ネット

トゥモロー・ネットは「ITをもとに楽しい未来へつなごう」という経営理念のもと、感動や喜びのある、より良い社会へと導く企業を目指し、最先端のテクノロジーとサステナブルなインフラを提供しています。設立以来培ってきたハードウェア・ソフトウェア製造・販売、運用、保守などインフラに関わる豊富な実績と近年注力するAIサービスのコンサルティング、開発、運用、サポートにより、国内システムインテグレーション市場においてユニークなポジションを確立しています。

インフラからAIサービスまで包括的に提供することで、システム全体の柔軟性、ユーザビリティ、コストの最適化、パフォーマンス向上など、お客様の細かなニーズに沿った提案を行っています。