NVIDIA L40Sとは?その性能や用途についてNVIDIA A100との違いを解説【トゥモロー・ネット テックブログ】

NVIDIAは、深層学習・人工知能(AI)におけるタスク処理を高速かつ確実に実行するGPUを開発しています。「NVIDIA L40S」も、AIやグラフィックスパフォーマンスのためのGPUとして有名になりました。

しかし、NVIDIA L40Sとは、どのような性能を有したGPUなのでしょうか。

本記事では、「NVIDIA L40S」の性能や用途について解説します。前世代モデルである「NVIDIA A100」との比較もしてるので、ぜひ参考にしてください。

目次

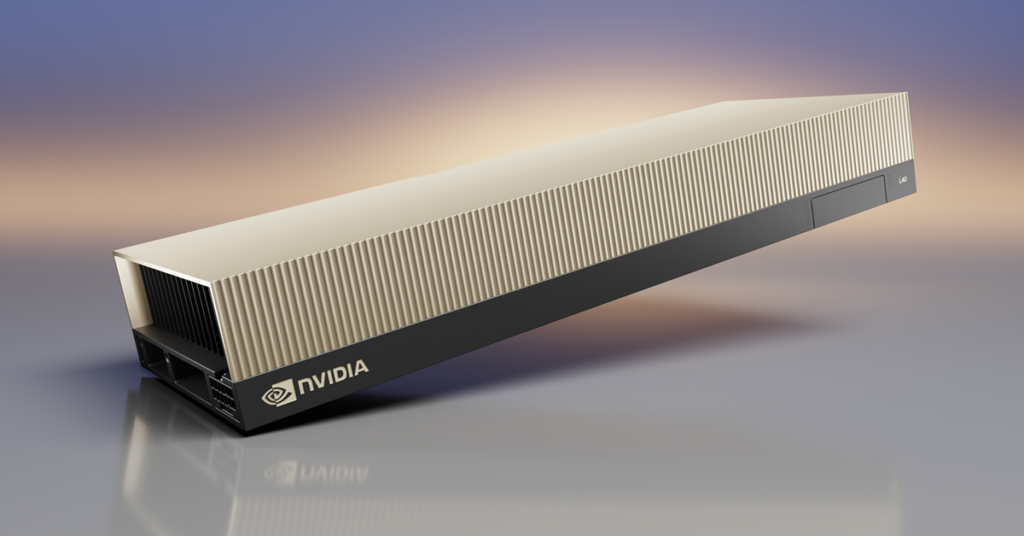

NVIDIA L40Sとは

NVIDIA L40Sは、美しいモデリングやアニメーションシーンの作成に貢献するGPUです。AIコンピューティングとグラフィックス、メディア高速化を組み合わせたハイエンド向けGPUとしても知られており、レンダリングなど別のシーンでも使用できる汎用性に注目が集まりました。

NVIDIA Ada Lovelace GPU アーキテクチャに基づいて設計されたGPUでもあり、第4世代 TensorコアとFP8 Transformer Engineが搭載されているのがポイントです。1.45ペタフロップスを超えるTensor処理能力を実現でき、複雑なAIワークフローにも対応します。

NVIDIA L40SとNVIDIA A100の違い

「NVIDIA L40S」は前世代「NVIDIA A100」に改良を加えたモデルでもあるため、性能差をチェックしておきましょう。

| NVIDIA L40S | NVIDIA A100 80GB SXM | |

| 利用用途 | 生成AI向けユニバーサルGPU | マルチノードAI向け最上級性能 |

| GPUアーキテクチャ | NVIDIA Ada Lovelace | NVIDIA Ampere |

| FP64 | N/A | 9.7 TFLOPS |

| FP32 | 91.61 TFLOPS | 19.5 TFLOPS |

| RTコア | 212 TFLOPS | N/A |

| TF32 Tensor コア | 366 TFLOPS | 312 TFLOPS |

| FP16/BF16 Tensor コア | 733 TFLOPS | 624 FLOPS |

| FP8 Tensor コア | 1466 TFLOPS | N/A |

| INT8 Tensor コア | 1466 TOPS | 1248 TOPS |

| GPU メモリー | 48 GB GDDR6 | 80 GB HBM2e |

| GPU メモリー帯域幅 | 864 GB/s | 2039 GB/s |

| パイプライン / CUDA コア | 10752 | 18176 |

| L2 キャッシュ | 96 MB | 40 MB |

| メディアエンジン | 3 NVENC (+AV1) 3 NVDEC 4 NVJPEG | 0 NVENC 5 NVDEC 5 NVJPEG |

| 消費電力(TDP) | 最大 350W | 最大 400 W |

| フォームファクター | 2-slot FHFL | 8-way HGX |

| インターコネクト | PCIe Gen4 x 16: 64 GB/s | PCIe Gen4 x 16: 64 GB/s |

| テクスチャの充填率 | 589.7 | 1,431 |

| 補助電源コネクタ | 8ピンEPS | 1x 16ピン |

| NVENC | NVDEC | 3x | 3x(+AV1 デコード) | 1x | 2x(+AV1 デコード) |

| 電源コネクター | 16 ピン CPU | 8 ピン CPU |

「NVIDIA L40S」は「NVIDIA A100」と比較してほぼ同等もしくはそれ以上の推論性能を持つように開発されたGPUであり、上位互換モデルとして活用できます。

この両者において、コンピュート用途での差異について比較すると以下のような内容で異なります。

コンピュート用途での差異比較とまとめ

- FP8 / Transformer Engine

- 倍精度浮動小数点数対応

- メモリ容量・帯域

- MIG(マルチインスタンスGPU)

- NVLINK対応など

「NVIDIA L40S」についてはハイブリッドのGPUで計算に強いだけでなく、グラフィックのメンテにおいても柔軟性があり、最先端のスピードは求めないが万能なGPUを求めるお客様に効果的です。

より高度な計算を素早く実行したいときは、「NVIDIA L40S」の方が利便性が高いと言えるでしょう。

NVIDIA L40Sの性能について

「NVIDIA L40S」には、下記の機能が搭載されています。一口にGPUと言ってもモデルや種類ごとに性能が異なるため、導入前に比較しておきましょう。

NVIDIA L40Sに搭載されている機能

第4世代Tensorコア

ディープラーニングに特化した演算回路であり、2024年時点における最新モデルである第4世代を搭載しています。AIで強化するグラフィックス機能をDLSSで加速させるなど複合的な使い方もでき、解像度を格段にアップできるのも特徴です。

第3世代RTコア

スループットとコンカレント レイトレーシングとシェーディング機能が強化されています。モーションブラーの軽減にも最適で、美しく滑らかなアニメーション生成が可能です。スループット、コンカレント レイトレーシング、シェーディング機能も前世代モデルより強化されているので、レイトレーシングのパフォーマンスが向上しました。

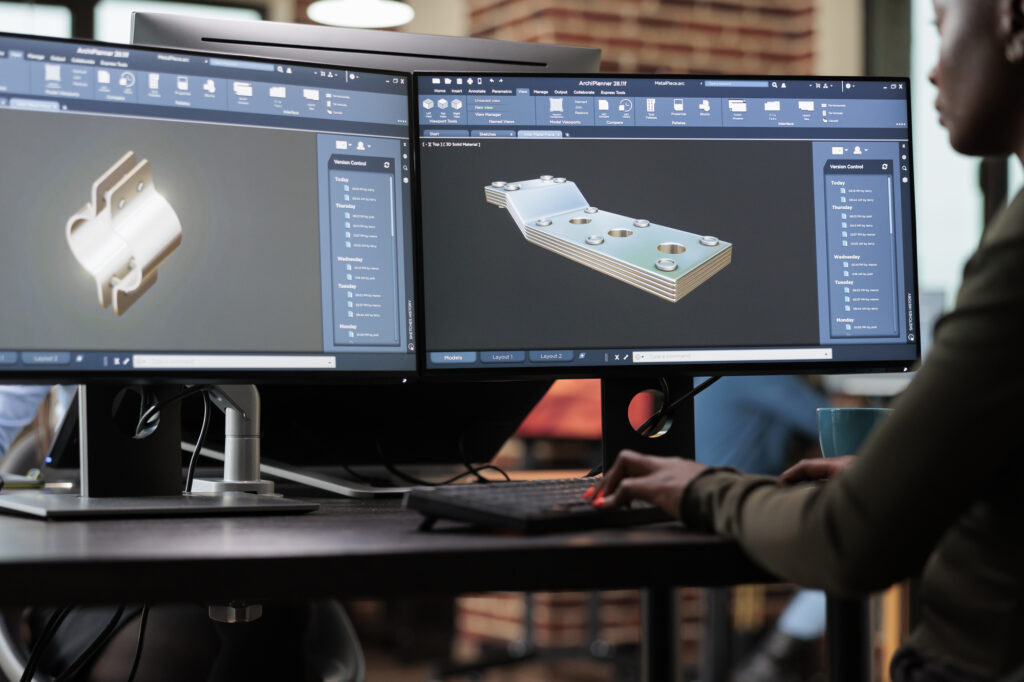

NVIDIA Ada Lovelace アーキテクチャCUDA コア

混合精度ワークロード向けの拡張16ビット演算機能を使用しています。3Dモデル開発やCAE(Computer-Aided Engineering)シミュレーションのパフォーマンスを向上させます。電力効率も向上し、ハイクオリティな計算が省エネで実現するようになっています。

効率性とセキュリティ

NEBSレベル3に対応する強固なセキュリティ環境で稼働しています。最大限のパフォーマンスを実現できるよう、NVIDIA によって設計・構築・テスト・サポートされています。24時間365日稼動するエンタープライズ向けのデータセンター運用にも最適です。

Transformer Engine

「Transformer Engine」は、Ada Lovelaceの第4世代 Tensorコアを利用しているのが特徴です。AIパフォーマンスの劇的な加速を実現し、メモリ使用率を大幅に改善しました。

FP8とFP16の精度を自動的に再構築し、より高速な AI パフォーマンスを実現できるのもメリットです。

DLSS 3

「DLSS 3」は革新的なAIグラフィックス技術であり、高品質な追加フレームを生成できるのがポイントです。超高速のレンダリングと滑らかなフレームレートを可能とし、さまざまなシーンで役立ちます。まるで現実かのような滑らかなアニメーションを生成でき、違和感を最小限に抑えます。

以下は、「NVIDIA L40S」のスペック詳細一覧です。

| GPUアーキテクチャ | NVIDIA Ada Lovelace アーキテクチャ |

| GPUメモリー | 48GB GDDR6 ECC付き |

| メモリー帯域幅 | 864GB/s |

| インターコネクトインターフェース | PCle Gen4 × 16 : 64GB/s 双方向 |

| NVIDIA Ada Lovelace アーキテクチャベースの CUDA コア | 18,176 |

| NVIDIA 第3世代 RT コア | 142 |

| NVIDIA 第4世代 Tensor コア | 568 |

| RTコア性能TFLOPS | 209 |

| FP32 TFLOPS | 91.6 |

| TF32 Tensor コア TFLOPS | 183 | 366 |

| BFLOAT16 Tensor コア TFLOPS | 362.05 | 733 |

| FP16 Tensor コア | 362.05 | 733 |

| FP8 Tensor コア | 733 | 1,466 |

| ピークINT8 Tensor TOPS | 733 | 1,466 |

| ピークINT4 Tensor TOPS | 733 | 1,466 |

| フォームファクター | 4.4(H) × 10.5(L),デュアルスロット |

| ディスプレイポート | 4x DisplayPort 1.4a |

| 最大消費電力 | 350W |

| 電源コネクター | 16-pin |

| サーマル | パッシブ |

| 仮想GPUソフトウェア対応 | Yes |

| NVENT NVDEC | 3x | 3x (AV1エンコードとデコードを含む) |

| ルートオブトラスト対応セキュアブート | Yes |

| NEBS準拠 | Level3 |

| MIGサポート | No |

| NVIDIA NVLinkサポート | No |

NVIDIA L40Sの活用シーン

「NVIDIA L40S」の代表的な活用シーンとして、下記が挙げられます。

【NVIDIA L40Sの代表的な活用シーン】

- 生成AIの作成

- 3Dグラフィックスの作成

- LLMのトレーニングと推論

- レンダリング

- メタバースアプリケーションの作成・運用

例えば、画像・動画・3D・360 HDRiなど、ありとあらゆるコンテンツを画像プロンプトから生成できるようになります。画像や動画の編集だけでなく、仮想世界にデジタルアバターを設置して縦横無尽に操作するなど、多角的な活用法があるのがポイントです。

その他、生成AIを活用すればカスタマイズされた会話やアニメーションを楽しむこともでき、ソフトウェアやゲームで展開できるなど道が広がります。

また、科学の分野で活用すれば分子構造と機能を短時間で学習して新薬候補の開発を急げるなど、社会的な利益も大きくなります。

AIは、推論によってイノベーションを促進するのも得意なので、シミュレーションの自動化やスピード化にも最適です。これまで膨大な手間と時間がかかっていた処理が短時間で終えられるようになり、業務効率化を促進できます。

まとめ

「NVIDIA L40S」は2023年8月にリリースされたGPUであり、美しいグラフィックスの作成を可能にしています。単精度浮動小数点(FP32)スループットの高速化と電力効率の向上に役立つCUDAコアを搭載しており、生成AIやシミュレーションの自動化などありとあらゆるシーンで活用できるようになりました。また、「NVIDIA L40S」は前世代モデルである「NVIDIA A40」と比較して最大5倍の推論性能を持っているのも特徴です。

トゥモロー・ネットでご支援できること

トゥモロー・ネットでは、NVIDIAのパートナーとしてL40SをはじめとするGPU製品の販売や導入サポートを実施しています。きめ細やかな提案、構築、導入を提供いたしますので、GPUをお探しの方はぜひお問合せください。

お問合せ先

関連ページ

クラウドコンピューティングとは?仕組みやメリット・デメリットを解説

NVIDIA H100とは?その性能やおすすめの利用シーンを解説

この記事を書いた人

株式会社トゥモロー・ネット クラウドソリューション本部

トゥモロー・ネットは「ITをもとに楽しい未来へつなごう」という経営理念のもと、感動や喜びのある、より良い社会へと導く企業を目指し、最先端のテクノロジーとサステナブルなインフラを提供しています。設立以来培ってきたハードウェア・ソフトウェア製造・販売、運用、保守などインフラに関わる豊富な実績と近年注力するAIサービスのコンサルティング、開発、運用、サポートにより、国内システムインテグレーション市場においてユニークなポジションを確立しています。

インフラからAIサービスまで包括的に提供することで、システム全体の柔軟性、ユーザビリティ、コストの最適化、パフォーマンス向上など、お客様の細かなニーズに沿った提案を行っています。